Big Data, a predictive maintenance

Katgoria: BUSINESS INTELLIGENCE / Utworzono: 27 wrzesień 2017

Wraz z pojawieniem się nowych możliwości, które rozpowszechniły kocepcję obliczeń rozproszonych, koszt związany z gromadzeniem danych znacznie się zmniejszył. Wielu przedsiębiorców zaczęło przechowywać dane, które nie były dotychczas wykorzystywane produkcyjnie, z nadzieją, iż drzemiący w nich potencjał pozwoli im w przyszłości uzyskać przewagę konkurencyjną. W dobie Internet of Things, ilość generowanych danych przez otaczające nas urządzenia jest ogromna. Szybko okazało się, że skoro przechowywanie danych nie wiąże się z dużymi kosztami, jedynym ograniczeniem jest kreatywność analityków.

Analityka w klasycznym wydaniu polega na znalezieniu odpowiedzi na wcześniej postawione i znane już pytania. W świecie Big Data sprawa wygląda nieco inaczej. Wyszukuje się nowych, nieodkrytych dotąd problemów i miejsc, w których można poprawić, usprawnić działalność przedsiębiorstwa, wpłynąć na działalność operacyjną i dzięki temu przyczynić się do poprawy wyniku finansowego. Przedstawione podejście wymaga dokładnego poznania i zrozumienia danych oraz otoczenia gospodarczego.

Jedną z metodologii, która pozwala na ustandaryzowanie procesów związanych z eksploracją i analizą danych jest CRISP-DM (Cross Industry Standard Process for Data Mining). Zakłada on, że każdy projekt z dziedziny analizy danych powinien składać się z następujących faz:

Jedną z metodologii, która pozwala na ustandaryzowanie procesów związanych z eksploracją i analizą danych jest CRISP-DM (Cross Industry Standard Process for Data Mining). Zakłada on, że każdy projekt z dziedziny analizy danych powinien składać się z następujących faz:

- Zrozumienie uwarunkowań biznesowych.

- Zrozumienie danych.

- Przygotowanie danych.

- Modelowanie.

- Ewaluacja.

- Wdrożenie.

Pierwszy punkt pozwala zrozumieć profil, charakter, pozycję rynkową przedsiębiorstwa, jej codzienną działalność i problemy, z którymi się mierzy. Istotne jest również zrozumienie danych, ponieważ to one są źródłem wszelkich informacji. Często jakość danych pozostawia wiele do życzenia, stąd lepsze ich zrozumienie jest niezbędne, by mogły zostać właściwie oczyszczone w następnym kroku. Szacuje się, że przygotowanie danych jest najbardziej czasochłonnym krokiem w procesach analitycznych. Modelowanie i ewaluacja polegają na budowaniu modeli i wybraniu spośród nich tego, o największej zdolności predykcyjnej. Ostatnim krokiem jest produkcyjne wdrożenie, ale cykl życia modelu statystycznego jest znacznie dłuższy, ponieważ w trakcie korzystania z modelu może okazać się, że konieczne będzie dostosowanie jego parametrów w celu polepszenia jego jakości.

[źródło: Shearer, C. (2000) The CRISP-DM Model: The New Blueprint for Data Mining. Journal of Data Warehousing, 5, 13-22.]

Predictive a Preventive Maintenance

Dbanie o jakość i niezawodność świadczonych usług jest w dzisiejszych czasach jednym z najistotniejszych elementów, który pozwala na budowanie dobrego wizerunku w oczach klientów. Dostęp do dużych zbiorów danych pochodzących z sensorów maszyn produkcyjnych umożliwił nieustanne analizowanie stanu urządzeń w celu uniknięcia jakichkolwiek niespodziewanych awarii.

Wiele firm stosuje koncepcję znaną jako preventive maintenance. Polega ona na definiowaniu zużycia sprzętu na podstawie czasu jego amortyzacji. Prace konserwacyjne wykonywane są według określonego harmonogramu, który nie ma w żaden sposób związku z rzeczywistym stanem. Jest on jedynie rekomendacją wydaną na podstawie przeszłych awarii, doświadczeń. Utrzymywanie stanu technicznego infrastruktury według tej metody jest skuteczne, jednak z jedenj strony nie chroni wystarczająco dobrze przed niespodziewanymi awariami, a z drugiej - czasem wymaga przeprowadzania akcji serwisowych wynikających z harmonogramu mimo tego, że są one całkowicie zbędne.

Predictive maintenance jest calkowicie odmienną koncepcją, która bazując na danych pochodzących z sensorów urządzeń oraz modeli statystycznych, bądź algorytmów uczenia maszynowego, jest w stanie w czasie rzeczywistym zweryfikować stan urządzenia i ocenić jakie działania są potrzebne by uniknąć niespodziewanych awarii. Dane historyczne wykorzystywane są w celu odkrycia zależności, które pozwolą przewidzieć wszelkie niepożądane zdarzenia. Powstałe modele statystyczne są następnie implementowane w ramach tzw. silników reguł, które w zależności od założeń biznesowych, mogą działac w trybie real-time, micro-batch (umożliwiając analizę danych w czasie zbliżonym do rzeczywistego) lub w trybie wsadowym. Bardziej dynamiczne rozwiązania pozwalają na automatyczne odświeżanie modeli statystycznych według określonego interwału czasowego i natychmiastowe dostosowywanie parametrów silnika reguł tak, że proces uczenia się i wdrożenia nowonauczonego modelu są w pełni zautomatyzowane.

[źródło: Mobley R. K. (2002) An Introduction to Predictive Maintanance.

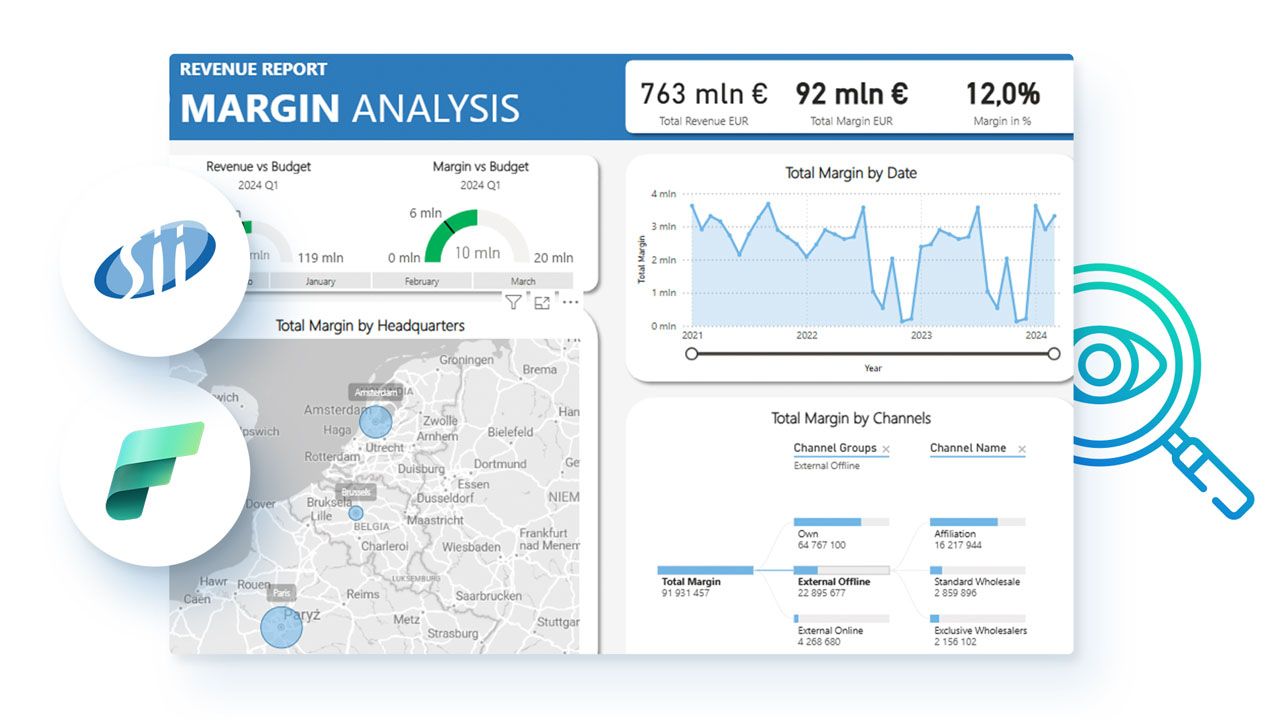

Predictive Maintanance w praktyce – przykładowa implementacja Za przykład systemu analizującego zdarzenia infrastruktury, posłuży zaimplementowany w tym roku system CEP (Complex Event Processing) dla jednego z operatorów telekomunikacyjnych oparty o klaster Big Data.

Do jego powstania przyczyniły się nastepujące potrzeby biznesowe:

[źródło: Shearer, C. (2000) The CRISP-DM Model: The New Blueprint for Data Mining. Journal of Data Warehousing, 5, 13-22.]

Predictive a Preventive Maintenance

Dbanie o jakość i niezawodność świadczonych usług jest w dzisiejszych czasach jednym z najistotniejszych elementów, który pozwala na budowanie dobrego wizerunku w oczach klientów. Dostęp do dużych zbiorów danych pochodzących z sensorów maszyn produkcyjnych umożliwił nieustanne analizowanie stanu urządzeń w celu uniknięcia jakichkolwiek niespodziewanych awarii.

Wiele firm stosuje koncepcję znaną jako preventive maintenance. Polega ona na definiowaniu zużycia sprzętu na podstawie czasu jego amortyzacji. Prace konserwacyjne wykonywane są według określonego harmonogramu, który nie ma w żaden sposób związku z rzeczywistym stanem. Jest on jedynie rekomendacją wydaną na podstawie przeszłych awarii, doświadczeń. Utrzymywanie stanu technicznego infrastruktury według tej metody jest skuteczne, jednak z jedenj strony nie chroni wystarczająco dobrze przed niespodziewanymi awariami, a z drugiej - czasem wymaga przeprowadzania akcji serwisowych wynikających z harmonogramu mimo tego, że są one całkowicie zbędne.

Predictive maintenance jest calkowicie odmienną koncepcją, która bazując na danych pochodzących z sensorów urządzeń oraz modeli statystycznych, bądź algorytmów uczenia maszynowego, jest w stanie w czasie rzeczywistym zweryfikować stan urządzenia i ocenić jakie działania są potrzebne by uniknąć niespodziewanych awarii. Dane historyczne wykorzystywane są w celu odkrycia zależności, które pozwolą przewidzieć wszelkie niepożądane zdarzenia. Powstałe modele statystyczne są następnie implementowane w ramach tzw. silników reguł, które w zależności od założeń biznesowych, mogą działac w trybie real-time, micro-batch (umożliwiając analizę danych w czasie zbliżonym do rzeczywistego) lub w trybie wsadowym. Bardziej dynamiczne rozwiązania pozwalają na automatyczne odświeżanie modeli statystycznych według określonego interwału czasowego i natychmiastowe dostosowywanie parametrów silnika reguł tak, że proces uczenia się i wdrożenia nowonauczonego modelu są w pełni zautomatyzowane.

[źródło: Mobley R. K. (2002) An Introduction to Predictive Maintanance.

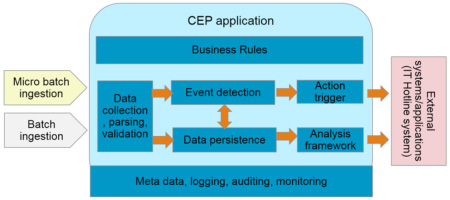

Predictive Maintanance w praktyce – przykładowa implementacja Za przykład systemu analizującego zdarzenia infrastruktury, posłuży zaimplementowany w tym roku system CEP (Complex Event Processing) dla jednego z operatorów telekomunikacyjnych oparty o klaster Big Data.

Do jego powstania przyczyniły się nastepujące potrzeby biznesowe:

- Poprawa relacji z klientem podczas kontaktu z linią wsparcia.

- Przyśpieszenie procesu wykrywania i naprawy usterek infrastruktury opowiedzialnej za dostarczanie sygnału internetowego oraz telewizyjnego do klientów.

- Od technicznej strony, zostały postawione następujące wymagania:

Stworzenie rozwiązania CEP opartego o silnik reguł (Rules Engine). - Skalowalność rozwiązania ze względu na ilość reguł stosowanych dla każdego nadchodzącego zdażenia infrastruktury.

- Zdolność do przetwarzania danych tak szybko jak są one dostępne (w praktyce przetwarzanie wsadowe (batch) każde 15/60 minut dla ok. 80 Gb danych) .

- Oparcie o rozwiązania open-source dostępne na platformie Cloudera CDH.

Zaimplementowany system CEP został przedstawiony na poniższej grafice:

Rysunek 1

Jego elementy można scharakteryzować następująco:

- Dane z elementów infrastruktury zostają załadowane z klastra HDFS (tabele Hive).

- Po ich walidacji odbywa się faza detekcji interesujących zdarzeń zgodnie z predefiniowanymi regułami biznesowymi.

- Historia analizy zostaje zapisana dla celów dalszego ulepszania i rozwijania reguł biznesowych, natomiast wyniki aktualne są udostępniane dla zainteresowanych systemów zewnętrznych, w tym wypadku systemu należącego do IT Hotline, a w przyszłości również do systemu działu odpowiedzialnego za usuwanie usterek infrastruktury.

- Pracownik IT Hotline po otrzymaniu zgłoszenia w ciągu kilku sekund otrzymuje informację o prawdopodobnej przyczynie usterki, o czym informuje kontaktującego się z nim klienta, po czym przysyła informacje dalej do działu infrastruktury.

Z technicznego punktu widzenia do implementacji zostały użyte następujące elementy zawarte na platformie Cloudera CDH:Hive/Impala, Spark, Solr, Oozie oraz serwis web oparty o Wildfly.

Aktualnie po udanym wdrożeniu na produkcję, następnym planowanym krokiem rozwoju systemu jest udoskonalenie go w taki sposób aby możliwe było proaktywne zgłaszanie miejsc występowania usterek i umożliwienie usunięcia ich zanim nastąpią w praktyce (np. wymiana karty sieciowej). W tym celu statyczne reguły biznesowe (matematyczne) zostana zastąpione przez algorytmy machine learning.

Auatorzy:

Dawid Benski – lat 34, Starszy Architekt działu Insights & Data w firmie Capgemini Software Solutions Center. we Wrocławiu. Posiada 7 lat doświadczenia w projektach bazodanowych i Business Intelligence oraz 3 lata doświadczenia w projektach Big Data.

Michał Dura – lat 25, Inżynier Oprogramowania w dziale Insights & Data w firmie Capgemini Software Solutions Center. we Wrocławiu. Posiada 2 lata doświadczenia w projektach Big Data.

Najnowsze wiadomości

Customer-specific AI: dlaczego w 2026 roku to ona przesądza o realnym wpływie AI na biznes

W 2026 roku sztuczna inteligencja przestaje być ciekawostką technologiczną, a zaczyna być rozliczana z realnego wpływu na biznes. Organizacje oczekują dziś decyzji, którym można zaufać, procesów działających przewidywalnie oraz doświadczeń klientów, które są spójne w skali. W tym kontekście coraz większe znaczenie zyskuje customer-specific AI - podejście, w którym inteligencja jest osadzona w danych, procesach i regułach konkretnej firmy, a nie oparta na generycznych, uśrednionych modelach.

PROMAG S.A. rozpoczyna wdrożenie systemu ERP IFS Cloud we współpracy z L-Systems

PROMAG S.A., lider w obszarze intralogistyki, rozpoczął wdrożenie systemu ERP IFS Cloud, który ma wesprzeć dalszy rozwój firmy oraz integrację kluczowych procesów biznesowych. Projekt realizowany jest we współpracy z firmą L-Systems i obejmuje m.in. obszary finansów, produkcji, logistyki, projektów oraz serwisu, odpowiadając na rosnącą skalę i złożoność realizowanych przedsięwzięć.

SkyAlyne stawia na IFS dla utrzymania floty RCAF

SkyAlyne, główny wykonawca programu Future Aircrew Training (FAcT), wybrał IFS Cloud for Aviation Maintenance jako cyfrową platformę do obsługi technicznej lotnictwa i zarządzania majątkiem. Wdrożenie ma zapewnić wgląd w czasie rzeczywistym w utrzymanie floty, zasoby i zgodność, ograniczyć przestoje oraz zwiększyć dostępność samolotów szkoleniowych RCAF w skali całego kraju. To ważny krok w modernizacji kanadyjskiego systemu szkolenia załóg lotniczych.

Wykorzystanie AI w firmach rośnie, ale wolniej, niż oczekiwano. Towarzyszy temu sporo rozczarowań

Wykorzystanie sztucznej inteligencji w firmach rośnie, ale tempo realnych wdrożeń pozostaje znacznie wolniejsze od wcześniejszych oczekiwań rynku. Dane pokazują, że z rozwiązań AI korzysta dziś wciąż niewiele przedsiębiorstw, a menedżerowie coraz częściej wskazują na bariery regulacyjne, koszty oraz brak powtarzalnych efektów biznesowych. W praktyce technologia jest testowana głównie w wybranych obszarach, a kluczowe decyzje nadal pozostają po stronie człowieka. Również w firmach, które wdrożyły AI, nierzadko towarzyszą temu rozczarowania.

Europejski przemysł cyfryzuje się zbyt wolno – ERP, chmura i AI stają się koniecznością

Europejski przemysł średniej wielkości wie, że cyfryzacja jest koniecznością, ale wciąż nie nadąża za tempem zmian. Ponad 60% firm ocenia swoje postępy w transformacji cyfrowej jako zbyt wolne, mimo rosnącej presji konkurencyjnej, regulacyjnej i kosztowej. Raport Forterro pokazuje wyraźną lukę między świadomością potrzeby inwestycji w chmurę, ERP i AI a realną zdolnością do ich wdrożenia – ograniczaną przez braki kompetencyjne, budżety i gotowość organizacyjną.

Europejski przemysł średniej wielkości wie, że cyfryzacja jest koniecznością, ale wciąż nie nadąża za tempem zmian. Ponad 60% firm ocenia swoje postępy w transformacji cyfrowej jako zbyt wolne, mimo rosnącej presji konkurencyjnej, regulacyjnej i kosztowej. Raport Forterro pokazuje wyraźną lukę między świadomością potrzeby inwestycji w chmurę, ERP i AI a realną zdolnością do ich wdrożenia – ograniczaną przez braki kompetencyjne, budżety i gotowość organizacyjną.

Najnowsze artykuły

5 pułapek zarządzania zmianą, które mogą wykoleić transformację cyfrową i wdrożenie ERP

Dlaczego jedne wdrożenia ERP dowożą korzyści, a inne kończą się frustracją, obejściami w Excelu i spadkiem zaufania do systemu? Najczęściej decyduje nie technologia, lecz to, jak organizacja prowadzi zmianę: czy liderzy biorą odpowiedzialność za decyzje czy tempo jest dopasowane do zdolności absorpcji oraz czy ludzie dostają klarowność ról i realne kompetencje. Do tego dochodzi pytanie: co po go-live - stabilizacja czy chaos w firmie? Poniżej znajdziesz 5 pułapek, które najczęściej wykolejają transformację i praktyczne sposoby, jak im zapobiec.

SAP vs Oracle vs Microsoft: jak naprawdę wygląda chmura i sztuczna inteligencja w ERP

Wybór systemu ERP w erze chmury i sztucznej inteligencji to decyzja, która determinuje sposób działania organizacji na lata — a często także jej zdolność do skalowania, adaptacji i realnej transformacji cyfrowej. SAP, Oracle i Microsoft oferują dziś rozwiązania, które na pierwszy rzut oka wyglądają podobnie, lecz w praktyce reprezentują zupełnie odmienne podejścia do chmury, AI i zarządzania zmianą. Ten artykuł pokazuje, gdzie kończą się deklaracje, a zaczynają realne konsekwencje biznesowe wyboru ERP.

Transformacja cyfrowa z perspektywy CFO: 5 rzeczy, które przesądzają o sukcesie (albo o kosztownej porażce)

Transformacja cyfrowa w finansach często zaczyna się od pytania o ERP, ale w praktyce rzadko sprowadza się wyłącznie do wyboru systemu. Dla CFO kluczowe jest nie tylko „czy robimy pełną wymianę ERP”, lecz także jak policzyć ryzyko operacyjne po uruchomieniu, ocenić wpływ modelu chmurowego na koszty OPEX oraz utrzymać audytowalność i kontrolę wewnętrzną w nowym modelu działania firmy.

Agentic AI rewolucjonizuje HR i doświadczenia pracowników

Agentic AI zmienia HR: zamiast odpowiadać na pytania, samodzielnie realizuje zadania, koordynuje procesy i podejmuje decyzje zgodnie z polityką firmy. To przełom porównywalny z transformacją CRM – teraz dotyczy doświadczenia pracownika. Zyskują HR managerowie, CIO i CEO: mniej operacji, więcej strategii. W artykule wyjaśniamy, jak ta technologia redefiniuje rolę HR i daje organizacjom przewagę, której nie da się łatwo nadrobić.

Composable ERP: Przewodnik po nowoczesnej architekturze biznesowej

Czy Twój system ERP nadąża za tempem zmian rynkowych, czy stał się cyfrową kotwicą hamującą rozwój? W dobie nieciągłości biznesowej tradycyjne monolity ustępują miejsca elastycznej architekturze Composable ERP. To rewolucyjne podejście pozwala budować środowisko IT z niezależnych modułów (PBC) niczym z klocków, zapewniając zwinność nieosiągalną dla systemów z przeszłości. W tym raporcie odkryjesz, jak uniknąć pułapki długu technologicznego, poznasz strategie liderów rynku (od SAP po MACH Alliance) i wyciągniesz lekcje z kosztownych błędów gigantów takich jak Ulta Beauty. To Twój strategiczny przewodnik po transformacji z cyfrowego "betonu" w adaptacyjną "plastelinę".

Oferty Pracy

-

Młodszy konsultant programista Microsoft Dynamics 365 Business Central

-

Konsultant programista Microsoft Dynamics 365 Business Central

-

Konsultant Microsoft Dynamics 365

-

Konsultant Wdrożeniowy Symfonia – księgowość

-

Microsoft Fabric Engineer (MFE)

-

Data/Business Analyst (PBI/Fabric)

-

CRM consultant

-

Starszy architekt systemów rozproszonych

-

Inżynier Zastosowań AI

Przeczytaj Również

Real-Time Intelligence – od trendu do biznesowego must-have

Sposób prowadzenia działalności gospodarczej dynamicznie się zmienia. Firmy muszą stale dostosowywa… / Czytaj więcej

EPM – co to jest? Czy jest alternatywą dla BI?

Nowoczesne systemy BI i EPM dostarczają wiedzy potrzebnej do efektywnego zarządzania firmą. Czy zna… / Czytaj więcej

W jaki sposób firmy zwiększają swoją odporność na zmiany?

Do zwiększenia odporności na zmiany, konieczna jest pełna kontrola nad codziennymi procesami zapewn… / Czytaj więcej

Dlaczego systemy kontrolingowe są potrzebne współczesnym firmom?

Narzędzia Corporate Performance Management (CPM) pozwalają na przyśpieszenie tempa podejmowania dec… / Czytaj więcej

Hurtownie danych – funkcje i znaczenie dla BI

Przepisów na sukces biznesu jest na rynku wiele. Nie ulega jednak wątpliwości, że jednym z kluczowy… / Czytaj więcej

Po co dane w handlu? Okazuje się, że ich analityka może dać nawet 30 proc. większe zyski!

Jak wynika z badania firmy doradczej Capgemni, producenci FMCG oraz firmy związane z handlem detali… / Czytaj więcej